Какая частота оперативной памяти лучше. Как скорость оперативной памяти влияет на игры и работу в программах

анонс новой утилиты измерения производительности с точки зрения приложений, зависимых от скорости работы памяти

Как правило, при тестировании производительности платформ акцент делается на процессорозависимые приложения. Но скорость системы зависит не только от центрального процессора. И сейчас мы даже не вспоминаем о графически насыщенных приложениях и использовании GPU для вычислений общего назначения, в которых значимую роль играет выбор видеокарты. Речь, как нетрудно догадаться, пойдет о влиянии производительности памяти, и нашей попытке количественно оценить это влияние.

Зависимость общей производительности системы от памяти имеет сложный характер, что затрудняет прямую оценку скорости памяти, то есть сравнения различных модулей. Например, память с частотой 1600 МГц имеет вдвое большую пропускную способность, чем 800-мегагерцовая. И синтетические тесты памяти прилежно выведут столбик в два раза выше. Но если вы протестируете целую систему с этими двумя видами памяти с помощью популярных тестовых приложений, на которых обычно тестируют процессоры, то и близко не получите двухкратной разницы в производительности. Интегральный индекс быстродействия может отличаться максимум на несколько десятков процентов.

Это делает синтетические тесты памяти малоинформативными с практической точки зрения. Нельзя, однако, поручиться и за то, что подход с применением реальных приложений дает нам стопроцентно достоверную картину, поскольку велика вероятность, что какие-то режимы, где производительность памяти действительно критична, остались без внимания и не были учтены.

Краткая теория

Чтобы понять специфику проблемы, рассмотрим принципиальную схему взаимодействия приложения, ЦП и подсистемы памяти. Уже давно для описания работы центрального процесса считается удачной аналогия с заводским конвейером. И движутся по этому конвейеру инструкции из программного кода, а функциональные модули процессора обрабатывают их словно станки. Тогда современные многоядерные ЦП будут подобны заводам с несколькими цехами. Например, работу технологии Hyper-Threading можно сравнить с конвейером, по которому едут вперемешку детали сразу нескольких автомобилей, и умные станки обрабатывают их одновременно, по метке на деталях определяя, к какой модели машины они относятся. Например, собирается красная и синяя машины, тогда красящий станок использует красную краску для деталей красной машины и синюю краску для синей. И поток деталей сразу для двух моделей позволяет лучше загрузить станки. А если аппарат для покраски будет иметь два распылителя, и сможет красить одновременно две детали в разные цвета, конвейер сможет работать на полную мощность вне зависимости от того, в каком порядке будут поступать детали. Наконец, последний писк моды, реализуемый в будущих процессорах AMD, в которых различные ядра ЦП будут иметь некоторые общие функциональные блоки, можно сравнить с идеей сделать часть особо громоздких и дорогих станков общей для двух цехов, чтобы сэкономить заводскую площадь и сократить капитальные затраты.

С точки зрения данной аналогии, системная память будет являться внешним миром, который поставляет на завод сырье и принимает готовый продукт, а кэш-память - это некий склад непосредственно на заводской территории. Чем больше у нас системной памяти, тем больший виртуальный мир мы можем обеспечивать выпускаемой продукцией, и чем больше частота ЦП и количество ядер, тем мощнее и производительнее наш завод. А чем больше размер кэш-памяти, то есть заводского склада, тем меньше будет обращений в системную память - запросов на поставку сырья и комплектующих.

Производительность памяти в этой аналогии будет соответствовать скорости транспортной системы по доставке сырья и отправке деталей во внешний мир. Допустим, доставка на завод осуществляется при помощи грузовиков. Тогда параметрами транспортной системы будут вместимость грузовика и скорость движения, то есть время доставки. Это хорошая аналогия, так как работа ЦП с памятью осуществляется с помощью отдельных транзакций с блоками памяти фиксированного размера, причем данные блоки расположены рядом, в одном участке памяти, а не произвольно. И для общей производительности завода важна не только скорость работы конвейера, но и оперативность подвоза компонентов и вывоза готовых изделий.

Произведение объема кузова на скорость движения, то есть количество грузов, которые можно перевезти в единицу времени, будет соответствовать пропускной способности памяти (ПСП). Но очевидно, что системы с одинаковой ПСП не обязательно равноценны. Важно значение каждого компонента. Скоростной маневренный грузовичок может оказаться лучше, чем большой, но медленный транспорт, так как необходимые данные могут лежать в различных участках памяти, расположенных далеко друг от друга, а вместимость грузовика (или объем транзакции) много меньше общего объема (памяти), и тогда даже большому грузовику придется совершить два рейса, и его вместимость не будет востребована.

Другие же программы имеют так называемый локальный доступ к памяти, то есть они читают или пишут в близко расположенные ячейки памяти - им относительно безразлична скорость случайного доступа. Это свойство программ объясняет эффект от наращивания объемов кэш-памяти в процессорах, которая, благодаря близкому расположению к ядру, в десятки раз быстрее. Даже если программа требует, например, 512 МБ общей памяти, в каждый отдельный небольшой промежуток времени (например, миллион тактов, то есть одна миллисекунда), программа может работать только с несколькими мегабайтами данных, которые успешно помещаются в кэше. И потребуется только обновлять время от времени содержимое кэша, что, в общем, происходит быстро. Но может быть и обратная ситуация: программа занимает всего 50 МБ памяти, но постоянно работает со всем этим объемом. А 50 МБ значительно превышают типичный размер кэша существующих настольных процессоров, и, условно говоря, 90% обращений к памяти (при размере кэша в 5 МБ) не кэшируются, то есть 9 из 10 обращений идут непосредственно в память, так как необходимых данных нет в кэше. И общая производительность будет почти полностью лимитирована скоростью памяти, так как процессор практически всегда будет находиться в ожидании данных.

Время доступа к памяти в случае, когда данных нет в кэше, составляет сотни тактов. И одна инструкция обращения к памяти по времени равноценна десяткам арифметических.

«Памятенезависимые» приложения

Позволим себе один раз использовать такой корявый термин для приложений, производительность в которых на практике не зависит от смены модулей на более высокочастотные и низколатентные. Откуда вообще такие приложения берутся? Как мы уже отметили, все программы имеют различные требования к памяти, в зависимости от используемого объема и характера доступа. Каким-то программам важна только общая ПСП, другие, наоборот, критичны к скорости доступа к случайным участкам памяти, которая иначе называется латентностью памяти. Но очень важно также, что степень зависимости программы от параметров памяти во многом определяется характеристиками центрального процессора - прежде всего, размером его кэша, так как при увеличении объема кэш-памяти рабочая область программы (наиболее часто используемые данные) может поместиться целиком в кэш процессора, что качественно ускорит программу и сделает её малочувствительной к характеристикам памяти.

Кроме того, важно, как часто в коде программы встречаются сами инструкции обращения к памяти. Если значительная часть вычислений происходит с регистрами, велик процент арифметических операций, то влияние скорости памяти снижается. Тем более что современные ЦП умеют изменять порядок выполнения инструкций и начинают загружать данные из памяти задолго до того, как те реально понадобятся для вычислений. Такая технология называется предвыборкой данных (prefetch). Качество реализации данной технологии также влияет на памятезависимость приложения. Теоретически, ЦП с идеальным prefetch не потребуется быстрая память, так как он не будет простаивать в ожидании данных.

Активно развиваются технологии спекулятивной предвыборки, когда процессор, даже ещё не имея точного значения адреса памяти, уже посылает запрос на чтение. Например, процессор для номера некоторой инструкции обращения к памяти запоминает последний адрес ячейки памяти, которая читалась. И когда ЦП видит, что скоро потребуется исполнить данную инструкцию, он посылает запрос на чтение данных по последнему запомненному адресу. Если повезет, то адрес чтения памяти не изменится, или изменится в пределах читаемого за одно обращение к памяти блока. Тогда латентность доступа к памяти отчасти скрадывается, поскольку параллельно с доставкой данных процессор исполняет инструкции, предшествующие чтению из памяти. Но, разумеется, такой подход не является универсальным и эффективность предвыборки сильно зависит от особенностей алгоритма программы.

Однако разработчики программ также в курсе характеристик современного поколения процессоров, и зачастую в их силах (при желании) оптимизировать объем данных таким образом, чтобы он помещался в кэш-памяти даже бюджетных процессоров. Если мы работаем с хорошо оптимизированным приложением - для примера можно вспомнить некоторые программы кодирования видео, графические или трехмерные редакторы, - у памяти, с практической точки зрения, не будет такого параметра, как производительность, будет только объем.

Еще одна причина, по которой пользователь может не обнаружить разницы при смене памяти, состоит в том, что она и так слишком быстрая для используемого процессора. Если бы сейчас все процессоры вдруг замедлились в 10 раз, то для производительности системы в большинстве программ стало бы абсолютно все равно, какой тип памяти в ней установлен - хоть DDR-400, хоть DDR3-1600. А если бы ЦП радикально ускорились, то производительность значительной части программ наоборот стала бы гораздо существеннее зависеть от характеристик памяти.

Таким образом, реальная производительность памяти есть величина относительная, и определяется в том числе и используемым процессором, а также особенностями ПО.

«Памятезависимые» приложения

А в каких пользовательских задачах производительность памяти имеет большее значение? По странной, но на самом деле имеющей глубокие основания причине - в случаях, которые сложно тестировать.

Тут сразу вспоминаются игрушки-стратегии со сложным и «медленным» искусственным интеллектом (ИИ). Ими никто не любит тестировать ЦП, так как инструменты для оценки либо отсутствуют, либо характеризуются большими погрешностями. На скорость выработки решения алгоритмом ИИ влияют множество факторов - например, иногда закладываемая в ИИ вариативность решений, чтобы сами решения выглядели более «человеческими». Соответственно, и реализация различных вариантов поведения занимает разное время.

Но это не значит, что у системы в данной задаче нет производительности, что она не определена. Просто её сложно точно вычислить, для этого потребуется собрать большое количество статистических данных, то есть провести множество испытаний. Кроме того, такие приложения сильно зависят от скорости памяти из-за использования сложной структуры данных, распределенных по оперативной памяти зачастую непредсказуемым образом, поэтому упомянутые выше оптимизации могут просто не работать или действовать неэффективно.

Достаточно сильно от производительности памяти могут зависеть и игры других жанров, пусть не со столь умным искусственным интеллектом, зато с собственными алгоритмами имитации виртуального мира, включая физическую модель. Впрочем, они на практике чаще всего упираются в производительность видеокарты, поэтому тестировать на них память также бывает не очень удобно. Кроме того, важным параметром комфортного игрового процесса в трехмерных играх от «первого лица» является минимальное значение fps: его возможное проседание в пылу жестокой битвы может иметь самые плачевные для виртуального героя последствия. А минимальный fps тоже, можно сказать, невозможно измерить. Опять же - из-за вариативного поведения ИИ, особенностей расчета «физики» и случайных системных событий, которые тоже могут приводить к проседанию. Как прикажете в таком случае анализировать полученные данные?

Тестирование скорости игр в демо-роликах имеет ограниченное применение еще и потому, что не все части игрового движка бывают задействованы для воспроизведения демки, и в реальной игре на скорость могут влиять иные факторы. Причем даже в таких наполовину искусственных условиях минимальный fps непостоянен, и его редко приводят в отчетах о тестировании. Хотя, повторимся, это наиболее важный параметр, и в тех случаях, когда идет обращение к данным, проседание fps весьма вероятно. Ведь современные игры, в силу своей сложности, разнообразия кода, включающего помимо поддержки физического движка и искусственного интеллекта также подготовку графической модели, обработку звука, передачу данных через сеть и пр., очень зависят как от объема, так и от производительности памяти. Кстати, будет заблуждением считать, что графический процессор обрабатывает сам всю графику: он только рисует треугольники, текстуры и тени, а формированием команд все равно занимается ЦП, и для сложной сцены это вычислительно емкая задача. К примеру, когда вышел Athlon 64 с интегрированным контроллером памяти, наибольший прирост в скорости по сравнению со старым Athlon был именно в играх, хотя там не использовались 64-битность, SSE2 и другие новые «фишки» Athlon 64. Именно существенное повышение эффективности работы с памятью благодаря интегрированному контроллеру сделало тогдашний новый процессор AMD чемпионом и лидером по производительности в первую очередь в играх.

Многие другие сложные приложения, прежде всего серверные, в случае которых имеет место обработка случайного потока событий, также существенно зависят от производительности подсистемы памяти. Вообще, используемое в организациях ПО, с точки зрения характера кода программы, зачастую не имеет аналогов среди популярных приложений для домашних персоналок, и поэтому весьма существенный пласт задач остается без адекватной оценки.

Ещё одним принципиальным случаем усиленной зависимости от памяти является режим многозадачности, то есть запуск нескольких ресурсоемких приложений одновременно. Вспомним снова все тот же AMD Athlon 64 с интегрированным контроллером памяти, который к моменту анонса Intel Core выпускался уже в двухъядерном варианте. Когда вышел Intel Core на новом ядре, процессоры AMD стали проигрывать везде, кроме SPEC rate - многопоточном варианте SPEC CPU, когда запускается столько копий тестовой задачи, сколько ядер в системе. Новое интеловское ядро, обладая большей вычислительной мощностью, тупо затыкалось в этом тесте в производительность памяти, и даже большой кэш и широкая шина памяти не помогали.

Но почему это не проявлялось в отдельных пользовательских задачах, в том числе многопоточных? Главной причиной было то, что большинство пользовательских приложений, которые в принципе хорошо поддерживают многоядерность, всячески оптимизированы. Вспомним в очередной раз пакеты для работы с видео и графикой, которые больше всех получают прирост от многопоточности - всё это оптимизированные приложения. К тому же объем используемой памяти меньше, когда код параллелится внутри программы - по сравнению с вариантом, когда запускаются несколько копий одной задачи, а тем более - разные приложения.

А вот если запустить на ПК сразу несколько различных приложений, нагрузка на память возрастет многократно. Это произойдет по двум причинам: во-первых, кэш-память будет поделена между несколькими задачами, то есть каждой достанется только часть. В современных ЦП кэш L2 или L3 - общий для всех ядер, и если одна программа использует много потоков, то они все могут выполняться на своем ядре и работать с общим массивом данных в L3-кэше, а если программа однопоточна, то ей достается весь объем L3 целиком. Но если потоки принадлежат различным задачам, объем кэша будет вынужденно делиться между ними.

Вторая причина заключается в том, что большее количество потоков создаст больше запросов на чтение-запись памяти. Возвращаясь к аналогии с заводом, понятно, что если на заводе работают все цеха на полную мощность, то сырья потребуется больше. А если они делают различные машины, то заводской склад будет переполнен различными деталями, и конвейер каждого цеха не сможет воспользоваться деталями, предназначенными для другого цеха, так как они от разных моделей.

Вообще, проблемы с ограниченной производительностью памяти - главная причина низкой масштабируемости многоядерных систем (после, собственно, приципиальных ограничений возможности распараллеливания алгоритмов).

Типичным примером такой ситуации на ПК будет одновременный запуск игры, «скайпа», антивируса и программы кодирования видеофайла. Пусть не типичная, но совсем не фантастическая ситуация, в которой очень сложно корректно измерить скорость работы, так как на результат влияют действия планировщика в составе ОС, который при каждом замере может по-иному распределять задачи и потоки по разным ядрам и давать им различные приоритеты, временны́е интервалы и делать это в разной последовательности. И опять-таки, наиболее важным параметром будет пресловутая плавность работы - характеристика, по аналогии с минимальным fps в играх, которую в данном случае измерить еще сложнее. Что толку от запуска игры или какой-то другой программы одновременно с кодированием видеофайла, если поиграть нормально не удастся из-за рывков изображения? Пусть даже видеофайл быстро сконвертируется, поскольку многоядерный процессор в данном случае может быть и недогружен. Здесь нагрузка на систему памяти будет гораздо больше, чем при исполнении каждой из перечисленных задач по отдельности.

В случае использования ПК как рабочей станции, ситуация одновременного исполнения нескольких приложений даже более типична, чем для домашнего ПК, и сама скорость работы ещё более важна.

Проблемы тестирования

Сразу целая группа факторов снижает чувствительность ЦП-ориентированных тестов к скорости памяти. Очень чувствительные к памяти программы представляют собой плохие тесты ЦП - в том смысле, что они слабо реагируют на модель ЦП. Такие программы могут различать процессоры с контроллером памяти, снижающим латентность доступа к памяти, и без оного, но при этом в пределах одного семейства почти не реагировать на частоту процессора, показывая сходные результаты при работе на частоте 2500 и 3000 МГц. Часто такие приложения отбраковываются как тесты ЦП, ибо тестеру просто непонятно, что лимитирует их производительность, и кажется, что дело в «чудачествах» самой программы. Будет удивительно, если все процессоры (и AMD, и Intel) покажут в тесте одинаковый результат, но такое вполне возможно для приложения, очень сильно зависимого от памяти.

Чтобы избежать упреков в необъективности и вопросов, почему выбрана та или иная программа, в тесты стараются включать только наиболее популярные приложения, которыми все пользуются. Но такая выборка не совсем репрезентативна: наиболее популярные приложения из-за своей массовости часто очень хорошо оптимизированы, а оптимизация программы начинается с оптимизации её работы с памятью - она важнее, например, чем оптимизация под SSE1-2-3-4. Но совсем не все на свете программы так хорошо оптимизируются; попросту на все программы не хватит программистов, которые умеют писать быстрый код. Опять возвращаясь к популярным программам кодирования, многие из них были написаны при непосредственном активном участии инженеров фирм-изготовителей ЦП. Как и некоторые другие популярные ресурсоемкие программы, в частности медленные фильтры двухмерных графических редакторов и движки рендеринга студий трехмерного моделирования.

В свое время было популярно сравнивать компьютерные программы с дорогами. Эта аналогия потребовалась, чтобы объяснить, почему на некоторых программах быстрее работает Pentium 4, а на некоторых Athlon. Интеловский процессор не любил ветвления и быстрее «ехал» по прямым дорогам. Это очень упрощенная аналогия, но она удивительно хорошо передает суть. Особенно интересно, когда две точки на карте соединяют две дороги - «оптимизированная» прямая качественная дорога и «неоптимизированная» кривая ухабистая. В зависимости от выбора одной из дорог, ведущих к цели, выигрывает тот или иной процессор, хотя в каждом случае они делают одно и тоже. То есть на неоптимизированном коде выигрывает Athlon, а при простой оптимизации приложения выигрывает Pentium 4 - и сейчас мы даже не говорим о специальной оптимизации под архитектуру Netburst: в таком случае Pentium 4 мог бы посоревноваться даже с Сore. Другое дело, что хорошие «оптимизированные» дороги строить дорого и долго, и это обстоятельство во многом предопределило печальную участь Netburst.

Но если мы отойдем от популярных наезженных трасс, то окажемся в лесу - там вообще нет никаких дорог. И немало приложений написаны безо всякой оптимизации, что почти неминуемо влечет сильную зависимость от скорости памяти в случае, если объем рабочих данных превышает размер кэша ЦП. К тому же множество программ пишутся на языках программирования, которые в принципе не поддерживают оптимизацию.

Специальный тест памяти

Для того чтобы корректно оценить влияние скорости памяти на производительность системы в случае, когда память имеет значение (для упомянутых «памятезависимых» приложений, мультизадачности и т. п.), исходя из всех вышеперечисленных обстоятельств и решено было создать специальный тест памяти, который по структуре кода представляет собой некое обобщенное сложное, зависимое от памяти приложение и имеет режим запуска нескольких программ.

Какие плюсы есть у такого подхода? Их очень много. В отличие от «натуральных» программ, возможен контроль над объемом используемой памяти, контроль над её распределением, контроль над количеством потоков. Специальное контролируемое выделение памяти позволяет нивелировать влияние особенностей менеджера памяти программы и операционной системы на производительность, чтобы результаты были не зашумлены, и можно было корректно и быстро тестировать. Точность измерения позволяет производить тест за относительно небольшое время и оценить большее количество конфигураций.

Тест основан на измерении скорости работы алгоритмов из типичных для сложных приложений программных конструкций, работающих с нелокальными структурами данных. То есть данные распределены в памяти достаточно хаотично, а не составляют один небольшой блок, и доступ в память не является последовательным.

В качестве модельной задачи была взята модификация теста Astar из SPEC CPU 2006 Int (кстати, предложенный для включения в этот пакет автором статьи; для теста памяти использован адаптированный для графов алгоритм) и задача сортировки данных с помощью различных алгоритмов. Программа Astar имеет сложный алгоритм с комплексным доступом к памяти, а алгоритмы сортировки числового массива - базовая задача программирования, использующаяся во множестве приложений; она включена, в том числе, для дополнительного подтверждения результатов сложного теста данными производительности простой, но распространенной и классической задачи.

Интересно, что существует несколько алгоритмов сортировки, но они отличаются по типу шаблона доступа к памяти. В некоторых доступ к памяти в целом локален, а другие используют сложные структуры данных (например, бинарные деревья), и доступ к памяти хаотичен. Интересно сравнить, насколько параметры памяти влияют при различном типе доступа - при том, что обрабатывается одинаковый размер данных и количество операций не сильно отличается.

Согласно исследованиям набора тестов SPEC CPU 2006, тест Astar - один из нескольких, в наибольшей мере коррелирующих с общим результатом пакета на x86-совместимых процессорах. Но в нашем тесте памяти объем используемых программой данных был увеличен, так как со времени выпуска теста SPEC CPU 2006 типичный объем памяти возрос. Также программа приобрела внутреннюю многопоточность.

Программа Astar реализует алгоритм нахождения пути на карте с помощью одноименного алгоритма. Сама по себе задача типична для компьютерных игр, прежде всего стратегий. Но используемые программные конструкции, в частности множественное применение указателей, также типичны для сложных приложений - например, серверного кода, баз данных или просто кода компьютерной игры, не обязательно искусственного интеллекта.

Программа осуществляет операции с графом, соединяющим пункты карты. То есть каждый элемент содержит ссылки на соседние, они как бы соединены дорогами. Есть два подтеста: в одном граф строится на основе двухмерной матрицы, то есть плоской карты, а во втором - на основе трехмерной матрицы, которая представляет собой некий сложный массив данных. Структура данных аналогична так называемым спискам - популярному способу организации данных в программах с динамическим созданием объектов. Такой тип адресации в целом характерен для объектно-ориентированного ПО. В частности, это практически все финансовые, бухгалтерские, экспертные приложения. И характер их обращений к памяти разительно контрастирует с типом доступа у оптимизированных на низком уровне вычислительных программ, вроде программ видеокодирования.

Каждый из подтестов имеет два варианта реализации многопоточности. В каждом из вариантов запускается N потоков, но в одном каждая из нитей осуществляет поиск пути на собственной карте, а в другом все нити ищут пути одновременно на одной карте. Так получаются несколько различных шаблонов доступа, что делает тест более показательным. Объем используемой памяти по умолчанию в обоих вариантах одинаков.

Таким образом, в первой версии теста получается 6 подтестов:

- Поиск пути на 2D-матрице, общая карта

- Поиск пути на 2D-матрице, отдельная карта для каждого потока

- Поиск пути на 3D-матрице, общая карта

- Поиск пути на 3D-матрице, отдельная карта для каждого потока

- Сортировка массива с использованием алгоритма quicksort (локальный доступ к памяти)

- Сортировка массива с использованием алгоритма heapsort (сложный доступ к памяти)

Результаты теста

Результаты теста отражают время нахождения заданного количества путей и время сортировки массива, то есть меньшее значение соответствует лучшему результату. В первую очередь качественно оценивается: реагирует ли в принципе данный процессор на заданной частоте на изменение частоты памяти или её настройки, частоту шины, тайминги и т. п. То есть отличаются ли результаты теста на данной системе при использовании различных типов памяти, или процессору хватает минимальной скорости.

Количественные результаты в процентах относительно конфигурации по умолчанию дают оценку прироста или падения скорости работы памятезависимых приложений или мультизадачной конфигурации при использовании различных типов памяти.

Тест сам по себе не предназначен для точного сравнения различных моделей ЦП, так как из-за того, что организация кэшей и алгоритмы предвыборки данных могут у них существенно отличаться, тест может отчасти благоволить определенным моделям. Но качественная оценка семейств ЦП между собой вполне возможна. А память производства различных компаний устроена одинаково, поэтому здесь субъективная составляющая исключена.

Также тест может быть использован для оценки масштабируемости процессоров по частоте при разгоне или внутри модельного ряда. Он позволяет понять, с какой частоты процессор начинает «затыкаться» в память. Часто процессор формально разгоняется сильно, и синтетические тесты, основанные на выполнении простых арифметических операций, показывают соответствующий изменению частоты прирост, но в памятезависимом приложении прироста может и не быть вообще из-за отсутствия соответствующего прироста в скорости памяти. Другая причина заключается в том, что ядро ЦП теоретически может потреблять больше энергии в случае сложного приложения и начнет либо сбоить, либо само снижать частоту, что не всегда возможно выявить в простых арифметических тестах.

Заключение

Если бы платформы и сокеты не менялись столь часто, то всегда можно было бы рекомендовать покупать самую быструю память, так как после апгрейда на новый более мощный и быстрый процессор возрастут и требования к памяти. Однако оптимальной стратегией все же является покупка сбалансированной конфигурации, поскольку сама память тоже прогрессирует, пусть и не так быстро, но ко времени смены процессора, вполне возможно, потребуется обновить и память. Поэтому тестирование производительности подсистемы памяти в сочетании с разными процессорами, в том числе в режиме разгона, остается актуальной и даже насущной задачей, которая позволит выбрать оптимальную связку, не переплачивая за лишние мегагерцы.

На самом деле, проблема ускорения доступа к данным - краеугольный камень современного процессоростроения. Узкое место здесь будет всегда, если только, конечно, сам процессор не будет состоять полностью из кэш-памяти, что, кстати, недалеко от истины - львиную долю площади кристаллов современных ЦП занимает как раз кэш-память разных уровней. (В частности, Intel заработал свои рекордные миллиарды, в том числе, благодаря тому, что в свое время разработал метод более плотного размещения кэшей на кристалле, то есть на единицу площади кристалла помещается больше ячеек кэша и больше байт кэш-памяти.) Однако всегда будут существовать приложения, которые либо невозможно оптимизировать таким образом, чтобы данные умещались в кэш-памяти, либо этим просто некому заниматься.

Поэтому быстрая память зачастую является столь же практичным выбором, как покупка внедорожника для человека, который хочет иметь возможность с комфортом передвигаться как по асфальту, так и по дорогам с «неоптимизированным» покрытием.

Производительность оперативной памяти | Может ли память ограничивать частоту кадров в играх?

С некоторой периодичностью мы публикуем материалы, в которых изучаем, как работа популярных приложений зависит от скорости работы обычной оперативной памяти. Сегодня под словом "обычной" мы подразумеваем DDR3-1600.

Поэкспериментировав с настройками памяти в одной из игр, мы заметили заметную прибавку в скорости работы. После обзора "FX против Core i7: является ли CPU в играх бутылочным горлышком?" у нас осталась готовая тестовая система, поэтому сейчас - самый подходящий момент, чтобы сделать ещё одну версию анализа игр, но с большим упором на память.

Сказанное нами шесть лет назад по поводу частоты и таймингов актуально и сегодня. Задержка CAS по-прежнему измеряется в циклах, циклы DDR3-2133 по-прежнему в два раза быстрее, чем DDR3-1066, а у DDR3-2133 CAS 10 осталось такое же время отклика, как у DDR3-1066 CAS 5. Более того, DDR3-2133 также предлагает в два раза больше пропускной способности, чем DDR3-1066.

К счастью, если бюджет ограничен, не обязательно зацикливаться на модулях DDR3-1066, а для повышения пропускной способности можно уменьшить значение CAS, которое для большинства модулей легко спустится ниже базового значения 10. Кроме того, дешёвая память DDR3-1600 и средняя по цене DDR3-2133 CAS 9 теперь стоит почти столько же.

Мы вооружены разогнанным CPU и двумя видеокартами Radeon HD 7970 в CrossFire, которые помогут избежать узких мест. Итак, каким образом изменения в конфигурации памяти повлияют на производительность в играх?

Производительность оперативной памяти | Конфигурация и тесты

| Тестовая конфигурация | |

| CPU | Intel Core i7-3960X (Sandy Bridge-E): 6ядер/12потоков 3,3 ГГц, 12 Мбайт общего кэша L3, LGA 2011 разгон до 4,4 ГГц (44 x 100 МГц) при напряжении ядра 1,325 В |

| Материнская плата | Asus P9X79, BIOS 3203 (11/26/2012) |

| Кулер CPU | Coolink Corator DS 120 мм Tower, термопаста w/Zalman ZM-STG1 |

| Сеть | Встроенный контроллер Gigabit LAN |

| Память | G,Skill F3-17600CL9Q-16GBXLD (16 Гбайт) DDR3-2200 CAS 9-11-9-36 1,65 В |

| Видеокарта | 2 x MSI R7970-2PMD3GD5/OC: GPU 1010 МГц, GDDR5-5500 |

| Накопитель | Mushkin Chronos Deluxe DX 240 Гбайт, SATA 6 Гбит/с SSD |

| Питание | Seasonic X760 SS-760KM: ATX12V v2,3, EPS12V, 80 PLUS Gold |

| ПО и драйвера | |

| Операционная система | Microsoft Windows 8 Professional RTM x64 |

| Графический драйвер | AMD Catalyst 12.10 |

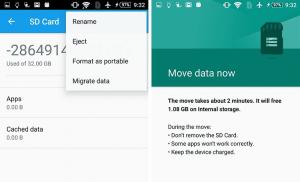

Платформа Intel LGA 2011 обладает достаточной гибкостью для тестов как двухканальной, так и четырёхканальной конфигурации памяти. ASUS P9X79 и разогнанный Core i7-3760X со степпингом C2 мы взяли из предыдущих обзоров.

Из-за базовой частоты в 100 МГц, системная плата P9X79 настроила старые модули G.Skill DDR3-2200 CAS 9 в режим DDR3-2133 CAS 9-11-9-28. Для тестов DDR3-1600 C9 мы использовали такую же память и тайминги. В варианте с пониженными таймингами используется эта же память в режиме DDR3-1600 CAS 7-9-7-21.

Если у вас есть пара карт Radeon HD 7970, вполне вероятно, что вы играете на разрешении 2560x1600 пикселей или больше. Мы начали с разрешения 1920x1080 пикселей и повышали его до 5760x1080 пикселей.

| Конфигурация тестов (3D-игры) | |

| Aliens vs. Predator | Использование AvP Tool v.1.03, SSAO/тесселяция/тени вкл. Тестовая конфигурация 1: качество текстур High, без AA, 4x AF Тестовая конфигурация 2: качество текстур Very High, 4x AA, 16x AF |

| Battlefield 3 | Режим кампании, "Going Hunting" 90-секунд Fraps Тестовая конфигурация 1: качество Medium (без AA, 4x AF) Тестовая конфигурация 2: качество Ultra (4x AA, 16x AF) |

| F1 2012 | Версия Steam, встроенный бенчмарк Тестовая конфигурация 1: качество High, без AA Тестовая конфигурация 2: качество Ultra, 8x AA |

| Elder Scrolls V: Skyrim | Обновление 1.7, Celedon Aethirborn уровень 6, 25-секунд Fraps Тестовая конфигурация 1: DX11, уровень детализации High без AA, 8x AF, FXAA вкл. Тестовая конфигурация 2: DX11, уровень детализации Ultra, 8x AA, 16x AF, FXAA вкл. |

| Metro 2033 | Полная версия, встроенный бенчмарк, сцена "Frontline" Тестовая конфигурация 1: DX11, High, AAA, 4x AF, без PhysX, без DoF Тестовая конфигурация 2: DX11, Very High, 4x AA, 16x AF, без PhysX, DoF вкл. |

Производительность оперативной памяти | Результаты тестов

Хотя 3DMark и не отражает реальную производительность в играх, он всё же позволяет легко сравнить показатели различных конфигураций. Также он показывает, что в тесте Physics с уменьшением скорости передачи данных памяти результат ухудшается. В этом есть смысл, поскольку пакет Physics даёт нагрузку на все вычислительные ядра. Нехватка данных для них – это верный путь снижения производительности.

В игре Aliens vs. Predator разница между различными конфигурациями памяти минимальна, даже на разрешении 2560x1600 пикселей частота кадров, похоже, сдерживается мощной комбинацией двух GPU Radeon HD 7970.

Результаты F1 и Metro 2033

Результаты F1 2012 наполняют смыслом всю нашу сегодняшнюю затею. Каждый шаг в увеличении пропускной способности памяти даёт заметный прирост скорости работы.

А вот Metro 2033 наоборот, не демонстрирует никакой значимой разницы между нашими четырьмя конфигурациями. Чуть ниже мы посмотрим на детальный разброс FPS в этой игре во время тестовых прогонов.

Metro 2033, секунда за секундой

Metro 2033 даёт нам весьма интересный посекундный график частоты кадров. Мы решили не включать графики каждого теста, поскольку это только засорит страницу. Вместо этого, мы сравнили самые медленные и самые быстрые конфигурации памяти.

Когда в качестве минимальной средней частоты кадров мы выбираем уровень 40 FPS, на самом деле мы отслеживаем, чтобы частота кадров не опускалась ниже 20 FPS. Наши видеокарты могут удержать такой уровень на настройках детализации Very High даже с памятью, установленной в режим DDR3-1600 CAS 9.

К сожалению, при разрешении 4800x900 пикселей уровень производительности на настройках Very High назвать нормальным никак нельзя. Чтобы игра работала на 5760x1080 пикселей, нам пришлось понизить детализацию.

При появлении в Metro 2033 дыма или тумана производительность существенно падает. Хорошо, что эти проседания во время геймплея на разрешении 5760x1080 пикселей с отключённым MSAA незаметны. Однако нас беспокоит, что с четырёхканальной конфигурацией впадины на графике ниже, ведь с увеличением пропускной способности ожидаешь уменьшения минимального порога, но никак не увеличения.

Battlefield 3 и Skyrim

Колебания производительности в Battlefield 3 слишком малы, чтобы отнести их к различиям в конфигурации. В таком случае, дешёвая память DDR3-1600 занимает здесь более выгодную позицию.

Elder Scrolls V: Skyrim выигрывает от более быстрой RAM, однако с увеличением разрешения и, соответственно, графической нагрузки, преимущество уменьшается.

Battlefield 3, кадр за кадром

Время рендеринга одного кадра более показательно, чем среднее количество кадров, поскольку именно отдельные медленные кадры разрушают погружение в игру, в результаты вы теряете концентрацию, врезаетесь в стену, либо вас убивают. Когда рекомендуемая нами для игр средняя частота кадров составляет 40 FPS, а минимальная 20, очень важно, чтобы ни один кадр не рендерился более 50 миллисекунд. В данном тесте чем ниже значения, тем лучше (быстрее).

Часто при запуске игра может идти с рывками, но в данном случае рывки совпадают с включением Fraps. К счастью, ни в одном из прогонов скачки не превышают порога 50 мс.

Skyrim, кадр за кадром

Длительность кадра в Elder Scrolls V: Skyrim превысила 50 мс лишь на разрешении 5760x1080 пикселей, при котором у всех конфигураций наблюдаются проблемы.

Хотя средняя частота кадров при настройках качества Ultra в Skyrim падает, скачки длительности кадра понижаются. В течение всего теста мы заметили только один долгий кадр на всех конфигурациях, что совсем не страшно.

Энергопотребление, средняя производительность и эффективность

Поскольку мы не используем разгон, то смогли понизить напряжение модулей, работающих в режиме DDR3-1600 C9 до 1,50 В и, соответственно, понизить общее энергопотребление системы на несколько ватт.

К сожалению, пониженная скорость передачи данных также повлияла на показатели средней производительности.

Intel XMP (Extreme Memory Profiles) – это настройки для автоматического разгона памяти. Поскольку более быстрая RAM повышает среднюю производительность в играх, с разгоном памяти эффективность системы увеличивается.

Производительность оперативной памяти | Пропускная способность и понижение таймингов иногда кое-что значат

Два из пяти игровых тестов: F1 2012 и The Elder Scrolls V: Skyrim продемонстрировали, что пропускная способность и тайминги могут существенно повлиять на частоту кадров в играх. Оба параметра оказываются одинаково важны. Такие результаты можно было предугадать, ведь эти две игры меньше ограничены графической подсистемой, чем другие.

С другой стороны, в Metro 2033, Battlefield 3 и Aliens vs. Predator мы вообще не заметили разницы. Производительность первых двух сильнее всего связана со скоростью графического адаптера (или адаптеров), установленного в системе, что объясняет, почему полоса пропускания и тайминги памяти не оказали существенного влияния. Появление долгих кадров, вызывающих проседания FPS, похоже, больше зависит от графической части системы, нежели от задержек или пропускной способности оперативной памяти.

Если говорить об играх, на производительность которых различия в памяти всё же влияют, то стоит отметить, что разницу во время геймплея можно заметить лишь в одной игре. Но даже в этом случае средняя частота кадров настолько высока, что ваши глаза (или мониторы) должны быть быстрее наших примерно в два раза, чтобы ощутить прирост от быстрой памяти на практике. В данном случае мы говорим об игре F1 2012, которая, в среднем, набирает более 100 FPS и всё равно масштабируется при ускорении работы памяти. На самом деле, такой уровень FPS важно поддерживать, если вы используете технологии AMD HD3D и Eyefinity одновременно, поскольку частота кадров для мониторов 60 Гц делится надвое. Если у вас нет трёх стереоскопических мониторов, большой прирост производительности к высокой частоте кадров нужен разве что для хвастовства.

Доброго времени суток дорогие посетители.

При покупке ОЗУ необходимо уделять внимание ее частоте. Вам известно, почему? Если нет, предлагаю ознакомиться с данной статьей, из которой вы узнаете, на что влияет частота оперативной памяти. Информация может пригодиться и тем, кто уже немного ориентируется в данной теме: вдруг вы еще чего-то не знаете?

Ответы на вопросы

Частоту оперативки правильнее назвать частотой передачи данных. Она показывает, какое их количество способно передать устройство за одну секунду посредством выбранного канала. Проще говоря, от данного параметра зависит производительность оперативной памяти. Чем он выше, тем быстрее она работает.

В чем измеряется?

Исчисляется частота в гигатрансферах (GT/s), мегатрансферах (MT/s) или в мегагерцах (МГц). Обычно цифра указывается через дефис в наименовании устройства, например, DDR3-1333.

Однако не стоит обольщаться и путать это число с настоящей тактовой частотой, которая вполовину меньше от прописанной в названии. На это указывает и расшифровка аббревиатуры DDR - Double Data Rate, что переводится как двойная скорость передачи данных. Поэтому, к примеру, DDR-800 на деле функционирует с частотой 400 МГц.

Максимальные возможности

Дело в том, что на устройстве пишут его максимальную частоту. Но это не значит, что всегда будет использоваться все ресурсы. Чтобы это стало возможным, памяти необходима соответствующая шина и слот на материнской плате с той же пропускной способностью.

Допустим, вы решили в целях ускорения работы своего компьютера установить 2 оперативки: DDR3-2400 и 1333. Это бессмысленная трата денег, потому что система сможет работать только на максимальных возможностях наиболее слабого модуля, то есть второго. Также, если вы установите плату DDR3-1800 в разъем на материнке с пропускной способностью 1600 МГц, то на деле получите последнюю цифру.

В виду того, что устройство не предназначено постоянно функционировать на максимуме, а материнка не соответствует таким требованиям, пропускная способность не увеличится, а, наоборот, понизится. Из-за этого могут происходить ошибки в загрузке и работе операционной системы.

Но параметры материнки и шины - не все, что влияет на быстродействие ОЗУ с учетом ее частоты. Что еще? Читаем далее.

Режимы работы устройства

Чтобы добиться наибольшей эффективности в работе оперативной памяти, возьмите во внимание режимы, которые устанавливает для нее материнская плата. Они бывают нескольких типов:

- Single chanell mode (одноканальный либо ассиметричный). Работает при установке одного модуля или нескольких, но с разными характеристиками. Во втором случае учитываются возможности самого слабого устройства. Пример приводился выше.

- Dual Mode (двухканальный режим или симметричный). Вступает в действие, когда в материнскую плату устанавливаются две оперативки с идентичным объемом, вследствие чего теоретически удваиваются возможности ОЗУ. Желательно ставить устройства в 1 и 3 слот либо во 2 и 4.

- Triple Mode (трехканальный). Тот же принцип, что и в предыдущем варианте, но имеется в виду не 2, а 3 модуля. На практике эффективность этого режима уступает предыдущему.

- Flex Mode (гибкий). Дает возможность повысить продуктивность памяти путем установки 2 модулей разного объема, но с одинаковой частотой. Как и в симметричном варианте, необходимо ставить их в одноименные слоты разных каналов.

Тайминги

В процессе передачи информации от оперативной памяти к процессору большое значение имеют тайминги. Они определяют, какое количество тактовых циклов ОЗУ вызовет задержку в возврате данных, которые запрашивает CPU. Проще говоря, этот параметр указывает время задержки памяти.

Измерение производится в наносекундах и прописывается в характеристиках устройства под аббревиатурой CL (CAS Latency). Тайминги устанавливаются в диапазоне от 2 до 9. Рассмотрим на примере: модуль с CL 9 будет задерживать 9 тактовых циклов при передаче информации, которую требует проц, а CL 7, как вы понимаете, - 7 циклов. При этом обе платы имеют одинаковый объем памяти и тактовую частоту. Тем не менее, вторая будет работать быстрее.

Из этого делаем несложный вывод: чем меньше количество таймингов, тем выше скорость работы оперативки.

На этом всё.

Вооружившись информацией из этой статьи, вы сможете правильно подобрать и установить оперативную память согласно своим потребностям.

Для того, чтобы описать как работает оперативная память, нужно написать целую диссертацию, в то время как разобраться в вопросе влияния скорости ОЗУ на игры и программы достаточно просто.

В первую очередь нужно отметить, что вид, объем, и частота оперативной памяти оказывают влияние на скорость передачи данных. Это значит, что насколько быстро будет работать программа и игра зависит от модулей ОЗУ. Чем больше памяти, чем выше рабочая частота, тем быстрее передаются данные и пользователь мгновенно получает ответ от софта на свой запрос. Именно на эти параметры нужно обращать внимание при покупке модулей оперативной памяти.

Какой оптимальный объем ОЗУ выбрать для ПК?

Операционная память – это энергозависимая микросхема, с помощью которой совершается обмен данными. При этом эти данные не сохраняются на ПК, я только обрабатываются и хранятся некоторое время, а точнее до выключения компьютера.

Передача данных между ОЗУ и процессором может осуществляться двумя способами:

- Через память нулевого уровня;

- Через кэш.

А вот скорость этой передачи зависит от объема ОЗУ. И если 32-битные системы не поддерживают больше 4 Гб, то более мощные 64-битные сборки могут поддерживать до 64 Гб оперативной памяти. Редко можно встретить ПК с 512 Мб и 1 Гб памяти. Это зачастую старые устройства с Windows XP.

Для функционирования системы и запуска большинства приложений нужно 2 Гб памяти. Однако скорость запуска программ будет не высокой и время отклика на действия пользователя составит от нескольких секунд до минуты.

Размера в 4 Гб памяти хватит для просмотра видео на YouTube, загрузки красочных интернет-страниц, просмотра фильмов, запуска игр на минимальных и средних настройках.

Объема 8 и 16 гигабайт более чем достаточно для любых задач, которые пользователь возлагает на свою операционную систему. В том числе, хорошо будет работать Windows 10, системные требования которой достаточно приличные.

32 Гб хватит для того, чтобы не беспокоиться о работе самых современных игр и мощных приложений. При этом запаса ОЗУ хватит на нескольких лет вперед.

ВАЖНО! Если у вас старый ПК, покупка дополнительных модулей ОЗУ не ускорит работы системы. Скорость ОЗУ будет заметна при модернизации процессора и видеокарты.

Влияние типа ОЗУ на скорость работы системы

Скорость работы приложений и передачи данных зависит не только от объема оперативной памяти, но и от её типа. В компьютерах, собранный за последние несколько лет, можно найти четыре варианта модулей ОЗУ:

- DDR (DDR1) – рабочая частота до 400 МГц. Используется на ПК старых образцов.

- DDR2 – рабочая частота до 1200 МГц. Использовалась на новых ПК несколько лет назад, но была практически полностью вытеснена новым поколением.

- DDR3 – рабочая частота до 2400 МГц. Это сравнительно новый вариант, который устанавливается на большинстве компьютерах бюджетного и среднего уровня.

- DDR4 – рабочая частота до 3200 МГц. Поддерживается только современными материнскими платами, и то не всеми. Имеет высокие показатели передачи данных.

Важно отметить, что чем выше рабочая частота оперативной памяти, тем быстрее работают приложения, в том числе запущенные одновременно на одном ПК. Поэтому, установив на своём компьютере планку DDR4, можно повысить скорость передачи информации практически в 2 раза. Однако с её заменой придётся менять и материнскую плату, и процессор. А это очень дорого и не всем по карману. Иногда гораздо выгоднее поставить ОЗУ большего объёма или с лучшими показателями частоты, нежели менять всю начинку системного блока.

Значение частоты для материнской платы

Показатели частоты важны для скорости работы компьютера. И практически все современные модели материнских плат выпускаются с величиной этого параметра для ОЗУ не меньше 1600 МГц. Однако, решив заменить на своём ПК или ноутбуке планку, стоит обратить внимание на возможности самой платы. Если мамка не поддерживает больше, к примеру, 1663 МГц, а установленная планка имеет частоту 1833 МГц, то скорость передачи информации будет ограничена меньшим значением, то есть 1663 МГц и модернизация не даст результатов.

Посмотреть допустимое значение для материнской платы можно в инструкции, которая поставляется вместе с продуктом.

Процессор компьютера хранит в оперативной памяти часть данных, которые нуждаются в обработке. Чем выше показатели и емкость оперативки, тем быстрее возможно выполнение различных задач, поставленных пользователем. Особенно критичным показателем оперативной памяти является ее объем. Важной характеристикой планки является частота записи или считывания данных.

Чем выше объем памяти, тем больше процессов может в ней храниться и тем быстрее будет доступ к хранящейся информации со стороны операционной системы и процессора компьютера.

Выбор планки

Перед произведением выбора необходимо узнать, какой тип планки установлен в компьютере. Большинство современных систем используют для работы DDR3 платы, которые выигрывают как в быстродействии, так и в стабильности работы у большинства других типов памяти. Еще не совсем популярность DDR2, правда большинство современных производителей отдает свое предпочтение в сторону DDR3. Тип планки может быть определен в соответствии с надписью на самой оперативке или по документации, которая шла в одном комплекте с компьютером.

При выборе объема оперативной памяти также следует подбирать наиболее оптимальное значение. Если вы используете компьютер для запуска офисных приложений и программ, увеличение оперативной памяти до показателя более чем 4 ГБ в сумме является бессмысленным. Для игровой системы подойдет объем памяти в 8 ГБ.

Планка оперативной памяти должна соответствовать используемому оборудованию, иначе значительного увеличения производительности добиться не удастся.

Частота работы приобретаемой планки также является показателем, который влияет на скорость работы компьютера. Важно, чтобы устанавливаемые модули имели одинаковую частоту. Например, если в компьютере будут установлены две платы с частотой по 1333 и 1866 МГц, итоговая частота работы обеих планок будет равняться 1333 МГц, т.е. второй модуль будет работать на меньшей мощности.

Увеличить производительность в играх также поможет двухканальный принцип работы оперативной памяти, который заключается в установке двух плат оперативной памяти меньшего объема в сторону более высокой скорости считывания информации. Например, для компьютера лучше установить 4 ГБ оперативки из 2-х планок по 2 ГБ. Производительность такой системы будет выше, чем у устройства только с одним модулем на 4 ГБ. Таким образом удастся добиться большей производительности системы, т.к. одна планка большего размера работает значительно медленней, чем память меньшего объема.